Z-Fold

Z-Fold: A Frustratingly Easy Post-Training Quantization Scheme for LLMs阅读笔记

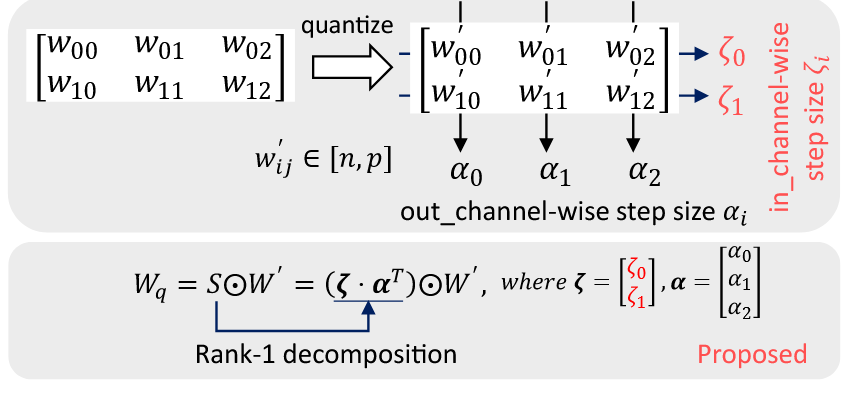

创新点1:引入in_channel scale构建高维逐元素scale

在已有的out_channel scale

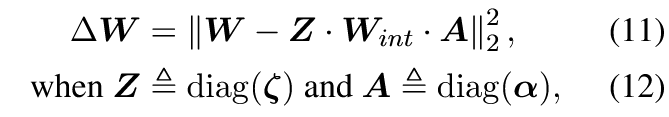

则量化带来的扰动可写作:

先用min-max初始化

创新点2:将

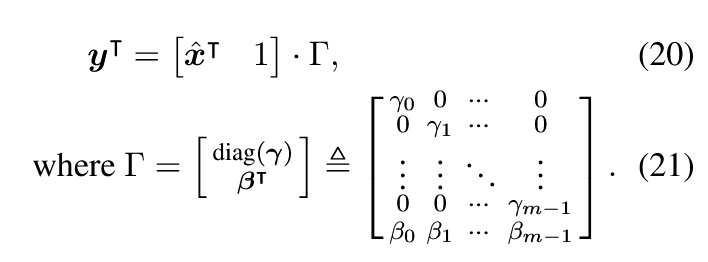

对于Norm后的线性层,其仿射变换可看作:

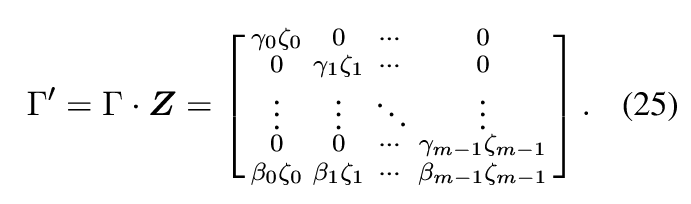

为了不引入其它参数将

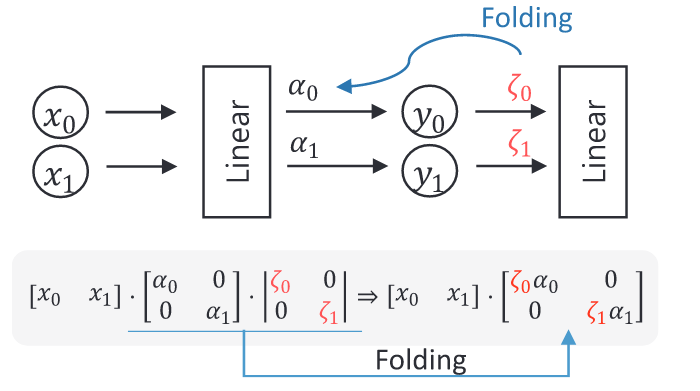

对于两线性层间除ReLU外无其他函数的线性层,直接将后一层的

其它

与2025的LRQ的都使用了低秩分解方法得到一个高维的逐单位scale,本方法还使用了类OPTQ的重建方法。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 由本自性清净故,令诸爱染悉无垢!